L’Ue prima al Mondo a definire linee guida e regole con un’attenzione particolare ai diritti fondamentali dei cittadini

Spesso abbreviata con l’acronimo A.I. (Artificial Intelligence, nell’acronimo italiano Ia) è la disciplina che studia la riproduzione mediante sistemi informatici di meccanismi relativi alle facoltà cognitive degli esseri umani. Le istituzioni europee hanno concluso nel dicembre scorso un accordo storico sul cosiddetto AI Act, una normativa pionieristica che stabilirà linee guida e regolamentazioni per l’intelligenza artificiale nel Continente. È la prima volta a livello mondiale che viene adottata una legge specifica per definire limiti e norme per questo settore in rapida evoluzione.

La definizione europea di “intelligenza artificiale”

Nella sua proposta di regolamento dell’aprile 2021, la Commissione europea ha scelto una definizione ampia di intelligenza artificiale, dove è descritta come un “sistema di intelligenza artificiale”, un software “sviluppato mediante una o più tecniche e approcci come l’apprendimento automatico” e “in grado, per un determinato insieme di obiettivi definiti dall’uomo, di generare risultati come contenuti, previsioni, raccomandazioni o decisioni che influenzano gli ambienti con cui interagisce”.

Nel dicembre 2023, gli eurodeputati e gli Stati membri hanno raggiunto un accordo su una proposta di regolamento volta a disciplinare l’Ia. La sfida centrale della strategia europea in questo settore mira a sviluppare l’intelligenza artificiale e il suo potenziale sociale ed economico, controllando al contempo i rischi che essa comporta per i diritti fondamentali degli esseri umani.

Nel dicembre 2023, gli eurodeputati e gli Stati membri hanno raggiunto un accordo su una proposta di regolamento volta a disciplinare l’Ia. La sfida centrale della strategia europea in questo settore mira a sviluppare l’intelligenza artificiale e il suo potenziale sociale ed economico, controllando al contempo i rischi che essa comporta per i diritti fondamentali degli esseri umani.

I molteplici utilizzi

Accanto agli usi ludici dell’Ia, si sono infatti sviluppate pratiche più controverse: il riconoscimento biometrico di massa, lo sviluppo di video deepfake (tecnica per la sintesi dell’immagine umana basata sull’Intelligenza artificiale), la classificazione dei cittadini in base al loro comportamento in Cina e il trattamento su larga scala dei dati personali da parte delle multinazionali digitali americane per scopi commerciali o politici.

Verso la creazione di un mercato unico dei dati in l’Europa

Essendo in ritardo rispetto agli americani e ai cinesi in termini di intelligenza artificiale, una delle priorità delle autorità europee è la creazione di un mercato unico dei dati. Sono il cuore dell’IA: permettono a un programma informatico di imparare a discernere immagini, suoni o comportamenti. Una merce redditizia, che spiega in parte perché i nostri dati personali e l’attività online degli utenti di Internet sono diventati oggetto di commercio nei modelli di business dei giganti digitali.

La costruzione di questo mercato unico era già iniziata con il Regolamento generale sulla protezione dei dati (GDPR) del 2016, che ne fornisce un quadro per l’utilizzo, in particolare dando agli utenti il diritto all’informazione, alla portabilità o all’oblio dei propri dati. Più recentemente, la legge europea sulla governance dei dati, EU Data Act, applicabile integralmente dal settembre 2023, ha anche stabilito le regole per il riutilizzo di alcuni dati pubblici o in possesso del settore pubblico che sono protetti, come quelli su Internet.

L’Unione europea investe sull’Intelligenza artificiale

L’obiettivo fissato nel piano dell’aprile 2021 è “aumentare gradualmente gli investimenti pubblici e privati nell’Ia per raggiungere un totale di 20 miliardi di euro all’anno” in Europa. Un uso efficiente dei dati significa finanziare sia le infrastrutture, in particolare per la raccolta e l’elaborazione, sia aumentare le competenze digitali dei cittadini europei. Per questo motivo si stanno mobilitando i programmi di finanziamento dell’Ue: la Commissione ha proposto di destinare ogni anno almeno 1 miliardo di euro dai programmi Digital Europe e Horizon Europe a progetti di intelligenza artificiale. Senza contare il piano di rilancio europeo, le cui versioni nazionali dovrebbero contribuire per il 20% alla transizione digitale negli Stati membri. Bruxelles ritiene quindi che le nuove tecnologie legate all’Ia siano un’opportunità e che offrano numerosi vantaggi sociali ed economici, in particolare in settori come l’agricoltura, la mobilità e la salute.

La protezione dei diritti fondamentali dei cittadini

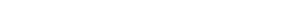

Tuttavia, l’Unione europea parte anche dal presupposto che l’Ia possa compromettere i  diritti fondamentali dei cittadini, come il diritto alla dignità umana, il rispetto della privacy e il principio di non discriminazione. Per questo motivo ha optato per un approccio all’Intelligenza artificiale “affidabile“ basato sul rischio. Nell’accordo del dicembre 2023 tra gli eurodeputati e gli Stati membri sul nuovo regolamento sull’Ia, si distinguono quattro categorie di rischio:

diritti fondamentali dei cittadini, come il diritto alla dignità umana, il rispetto della privacy e il principio di non discriminazione. Per questo motivo ha optato per un approccio all’Intelligenza artificiale “affidabile“ basato sul rischio. Nell’accordo del dicembre 2023 tra gli eurodeputati e gli Stati membri sul nuovo regolamento sull’Ia, si distinguono quattro categorie di rischio:

- Rischio inaccettabile: il divieto si applica alle pratiche che sfruttano la vulnerabilità dei bambini o delle persone con disabilità, come ad esempio un giocattolo che incoraggia un minore a comportarsi in un modo che potrebbe causare lesioni. Lo stesso vale per il social rating, il principio che prevede l’assegnazione di un marchio ai “buoni cittadini” o ai “buoni clienti”, consentendo loro di accedere a benefici sociali. Anche l’uso di sistemi di identificazione biometrica a distanza in tempo reale, come le telecamere per il riconoscimento facciale direttamente collegate ai database, rientra in questa categoria. Esistono tuttavia diverse eccezioni, come la ricerca di un bambino scomparso o la localizzazione di un colpevole o di un sospetto in casi di terrorismo, traffico di esseri umani o pornografia infantile.

- Rischio elevato: le norme sulla tracciabilità, la trasparenza e la solidità si applicano quando esiste la possibilità di un danno alla sicurezza o ai diritti delle persone. Questo vale per l’identificazione biometrica, la gestione di infrastrutture critiche (acqua, elettricità, ecc.), i sistemi di Intelligenza artificiale utilizzati per assegnare le persone agli istituti scolastici o per gestire le risorse umane, le applicazioni di Ia per l’accesso a servizi essenziali (prestiti bancari, servizi pubblici, prestazioni sociali, giustizia, ecc).

- Basso rischio: quando i rischi sono limitati, la normativa richiede un certo grado di trasparenza da parte del fornitore. Ad esempio, se gli utenti utilizzano un chatbot (software che simula ed elabora le conversazioni umane) online, devono essere informati che stanno parlando con un robot.

- Rischio minimo: tutti gli usi che non presentano rischi per i diritti dei cittadini secondo l’Ue, come i filtri antispam nelle e–mail, non sono soggetti a una supervisione specifica.

Il programma Europa digitale

«In un momento in cui le grandi aziende tecnologiche lanciano l’allarme sulle proprie creazioni, l’Unione europea ha fatto un passo avanti e ha proposto una risposta concreta ai rischi che l’Ia comincia a rappresentare», ha dichiarato il relatore del regolamento europeo sull’intelligenza artificiale, l’italiano Brando Benifei, anche capodelegazione del PD presso il Parlamento europeo.

Approvazione nella prossima sessione plenaria

All’inizio di febbraio 2024, gli Stati membri hanno convalidato l’intesa raggiunta con gli eurodeputati nel dicembre 2023. Dovranno quindi adottare l’accordo in sessione plenaria prima delle prossime elezioni europee del 9 giugno 2024, in modo che il regolamento sull’Intelligenza artificiale possa essere attuato. Il testo entrerà in vigore 20 giorni dopo la pubblicazione nella Gazzetta ufficiale dell’Unione europea. Sei mesi dopo, i sistemi di intelligenza artificiale interessati saranno vietati e le altre misure entreranno gradualmente in vigore.

All’inizio di febbraio 2024, gli Stati membri hanno convalidato l’intesa raggiunta con gli eurodeputati nel dicembre 2023. Dovranno quindi adottare l’accordo in sessione plenaria prima delle prossime elezioni europee del 9 giugno 2024, in modo che il regolamento sull’Intelligenza artificiale possa essere attuato. Il testo entrerà in vigore 20 giorni dopo la pubblicazione nella Gazzetta ufficiale dell’Unione europea. Sei mesi dopo, i sistemi di intelligenza artificiale interessati saranno vietati e le altre misure entreranno gradualmente in vigore.

Rossella Vezzosi

Foto © Orizzontipolitici.it, Europa.eu, Porto4